Validità della ricerca in sanità pubblica: prioritaria la coerenza epidemiologica dei dati

Leggi intervista al Prof. Marco Roccetti: L’AI è un moltiplicatore di potenza; se la si applica a un dato distorto, non si ottiene una verità corretta, ma un errore amplificato.

Pubblicato: 28 gennaio 2026 | Innovazione e ricerca

Una serie di interviste "Dialoghi sul Futuro Digitale" dedicate ad offrire spunti di riflessione e approfondimenti, a partire da convegni, seminari, progetti in ambito Terza Missione. Uno spazio per interagire e dialogare con docenti del Dipartimento, al fine di tratteggiare e comprendere alcuni percorsi futuribili o già presenti.

L'articolo è di Francesca Montuschi, del Settore della comunicazione e informazione del dipartimento.

L’integrità scientifica non è riconducibile solo all’etica: è il fondamento stesso della conoscenza. Le ipotesi di lavoro devono essere sempre fondate su una teoria solida e i dati utilizzati devono essere selezionati in maniera appropriata e consapevole. Il fenomeno del data dredging, ovverosia la ricerca indiscriminata di dati “interessanti” all’interno di grandi set di dati, rappresenta indubbiamente un pericolo per l’integrità scientifica.

Un dato non è mai grezzo: presuppone una definizione del fenomeno da misurare, una scelta di strumenti e metriche, una procedura di campionamento, nonché criteri di pulizia, normalizzazione e aggregazione. Ciascuna di queste fasi introduce assunzioni e potenziali distorsioni. Parlare di ecologia del dato significa, dunque, riconoscere che la selezione del dato è un atto epistemico, che influisce su ciò che può essere conosciuto e su ciò che resta invisibile, e che misurare comporta sempre controllare, escludere, selezionare, interpretare.

Quando i dati di base non superano inizialmente i controlli statistici, la scelta più responsabile è fermarsi e rivedere. I modelli sofisticati, infatti, non possono correggere dati difettosi; anzi, ne amplificano i bias strutturali, producendo in definitiva risultati a loro volta sofisticati, ma falsi.

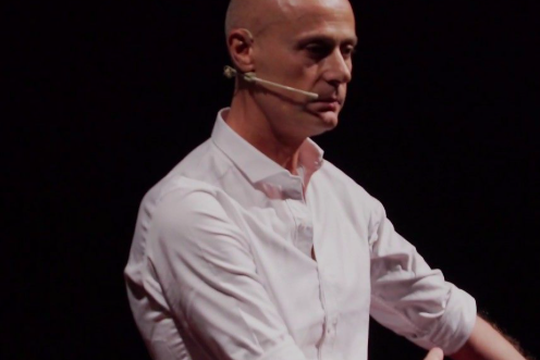

In questo contesto si inserisce il progetto di ricerca “Before the algorithm: An exemplar case of the necessity of statistical testing for epidemiological consistency in public health data”, del prof Marco Roccetti, del Dipartimento di Informatica, Scienza - Ingegneria, pubblicato su AIMS Public Health, che dimostra come grandi dataset possano portare a false inferenze: la validità della ricerca in sanità pubblica dipende, prima di tutto, dalla coerenza epidemiologica dei dati.

Dal suo recente studio emerge in modo forte e chiaro un aspetto imprescindibile: i risultati di un’analisi metodologicamente sofisticata (grazie a Big Data e Machine Learning), svolta nell’ambito della sanità pubblica, possono essere considerati affidabili se e solo se i dati di base superano inizialmente controlli statistici ed epidemiologici standard. In altre parole, i modelli sofisticati, quindi anche l’AI, non possono correggere dati difettosi.

“È esattamente così. Esiste un dogma pericoloso: l’idea che un algoritmo intelligente possa distillare verità da un mare di dati inquinati. Spesso, in informatica, si sente dire Garbage In, Garbage Out (se inserisci spazzatura, ottieni spazzatura). L’AI è un moltiplicatore di potenza: se la si applica a un dato distorto, non si ottiene una verità corretta, ma un errore potentissimo e, purtroppo, molto convincente”.

Il ricorso al modus tollens è uno degli assi portanti, seppur impliciti, dell’impianto argomentativo del suo lavoro. Lei dimostra che lo studio coreano pubblicato su Molecular Psychiatry non è metodologicamente valido e che, quindi, i suoi risultati non possono essere interpretati come effetti causali reali. Si tratta di una disconferma logica, non di una semplice critica quantitativa. In definitiva, viene affermato un principio fondamentale: quello della priorità della coerenza rispetto alla complessità.

“Rifacendomi alla mia pratica scientifica, è stato necessario ogniqualvolta mi sono trovato a fronteggiare un atteggiamento quasi "fideistico" nel metodo, a tal punto da oscurare il buon senso. Se, ad esempio, un modello matematico all'interno di un paper pubblicato segnala che la somministrazione di un vaccino fa scomparire il 70% dei casi di schizofrenia (come ho individuato nel mio studio), non devo fermarmi ad ammirare la sofisticatezza del modello: devo chiedermi, piuttosto, che cosa mi sia sfuggito del mondo reale. La coerenza con la realtà biologica ed epidemiologica deve sempre avere l’ultima parola. La complessità senza coerenza è solo rumore”.

Nella pratica quotidiana della ricerca (soprattutto quando coinvolge big data e database sanitari nazionali), la complessità metodologica può finire — questo è il rischio — per generare una legittimazione “a prescindere” dei risultati ottenuti. Così, ad esempio, il ricorso al Machine Learning diventa talvolta una garanzia simbolica, mentre i controlli di coerenza di base vengono dati per scontati.

“Oggi il ML/DL funge da bollino di qualità che inibisce lo spirito critico. Nella ricerca scientifica — che sarebbe il mio campo da gioco, ma il ragionamento si estende facilmente anche altrove — reviewer ed editor spesso si lasciano ipnotizzare dalla foresta di parametri tecnici e smettono di porre le domande elementari: “Ma questo numero è possibile?”. Si dà per scontato che, se il database è nazionale e il modello è moderno, il risultato sia certificato e certo. È una pigrizia intellettuale che delega alla macchina non tanto il giudizio etico, ma purtroppo anche quello scientifico”.

Promuovere l’integrità significa talvolta dover affermare “questo risultato non doveva essere pubblicato”, anziché “andava interpretato con cautela”, con un effetto potenzialmente destabilizzante dal punto di vista culturale. Inoltre, un paper che afferma “prima di fare Machine Learning bisogna fermarsi” non è in linea con la cosiddetta retorica dell’eccellenza.

“La retorica dell’eccellenza oggi premia chi corre, chi produce risultati sorprendenti, chi cavalca la novità. Fermarsi a dire “i dati di base hanno falle” viene percepito come un atto di sabotaggio, non di integrità. Eppure, la vera eccellenza non è pubblicare un errore complesso, ma avere l’onestà di riconoscere un limite semplice. Il progresso non è sempre aggiungere strati di complessità; a volte è eliminare un errore grossolano”.

Lavori come il suo possono essere percepiti come “scomodi”, perché mettono in crisi l’idea implicita che la complessità sia sempre progresso. Questo sposta la riflessione sull’integrità dalla morale individuale alla qualità delle pratiche collettive.

“Tocca a noi umani decidere se vogliamo sciogliere il paradosso per cui, mentre l’AI diventa sempre più umana (empatia, wit, comprensione del contesto), molti esseri umani si stanno trasformando in algoritmi difettosi: macchine che sanno solo dire “Errore 404: coraggio non trovato”.

Molto spesso le riviste ad alto impatto bibliometrico sembrano privilegiare la combinazione di novità, complessità e risultati sorprendenti. Dimostrare che “i dati di base sono incoerenti, quindi è bene fermarsi e non andare oltre” è sicuramente virtuoso dal punto di vista metodologico, ma può essere considerato debole da quello editoriale, che tende a valorizzare maggiormente la ricerca propositiva. È così?

“Ha centrato il punto più dolente. Per una rivista ad alto impatto, un paper che dice “non abbiamo trovato nulla perché i dati sono stati selezionati male” è meno appetibile di uno che urla “novità incredibile”. Ma la scienza avanza anche per sottrazione, non solo per accumulo. Se non iniziamo a premiare la manutenzione della verità tanto quanto la produzione di novità, finiremo per costruire una letteratura scientifica simile a cattedrali edificate sulla sabbia: facciate metodologiche sfarzose e algoritmicamente impeccabili che nascondono fondamenta empiriche inesistenti. Splendide da guardare, pericolose da abitare. Alla fine, in questi anni recenti, con un focus soprattutto sui dati sanitari, il mio lavoro è stato una sorta di ritorno agli studi di ingegneria, quando mi facevano fare i conti che fanno gli ingegneri strutturalisti, quelli che calcolano con rigore l’acciaio da mettere nelle fondamenta. Se il pilastro della logica e dei dati non regge, l’intero edificio scientifico, per quanto eccellente sulla carta, è destinato a cadere”.

Riproduzione riservata © copyright

Album